안녕하세요. GDGoC ai/ml파트 박지혜입니다.

제가 이번 윈터 블로그 챌린지에서 다룰 이야기는 인공지능의 침체기, 인공지능의 겨울이라고 불렸던 시기와 이 문제를 극복한 이야기입니다.

인공지능(AI)은 오늘날 전 세계를 뒤흔드는 기술이지만, 그 여정에는 많은 도전과 좌절이 있었습니다. 특히, "인공지능의 겨울(AI Winter)"로 불리는 시기는 인공지능 연구가 큰 난관에 부딪혀 발전이 정체된 시기로 잘 알려져 있습니다. 이 글에서는 XOR 문제를 중심으로 인공지능의 겨울이 찾아오게 된 배경과 이를 극복한 기술적 혁신에 대해 이야기해보겠습니다.

1958년, 프랭크 로젠블랫(Frank Rosenblatt)은 인공지능 연구의 역사적인 순간을 열었습니다. 그는 생물학적 뉴런을 모방한 퍼셉트론(Perceptron)이라는 단순한 신경망 모델을 제안했습니다. 이 퍼셉트론은 AND, OR과 같은 기본 논리 연산을 수행할 수 있었고, 데이터의 패턴을 학습하는 능력을 보여주며 학계의 큰 주목을 받았습니다.

당시 사람들은 "인공지능이 인간처럼 사고할 날이 곧 올 것" 이라는 낙관적인 전망을 내놓았습니다. 그러나 이 낙관론은 오래가지 못했습니다.

퍼셉트론의 한계는 마빈 민스키(Marvin Minsky)와 시모어 페퍼트(Seymour Papert)의 책 "Perceptrons"에서 명확히 드러났습니다. 그들은 퍼셉트론이 선형 분리가 불가능한 문제를 해결할 수 없다는 점을 증명했습니다.

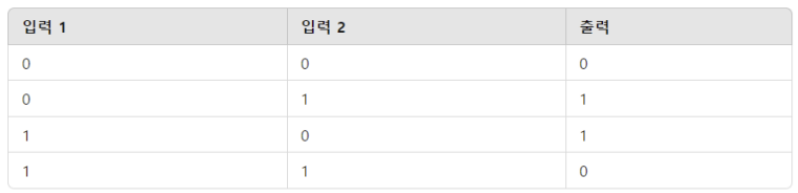

그 중 대표적인 예가 바로 XOR 문제입니다. XOR(배타적 논리합)은 다음과 같은 규칙을 따릅니다.

퍼셉트론은 이러한 XOR 문제를 해결할 수 없었습니다. 그 이유는 단층 퍼셉트론이 선형 결정 경계(직선)만을 그릴 수 있기 때문입니다. 위의 그림과 같이 흰색 점과 검은색 점을 하나의 직선으로 나눌 수 없듯이 XOR 문제는 선형적으로 분리할 수 없는 패턴을 가지기 때문에, 단층 퍼셉트론으로는 학습할 수 없는 구조적 한계를 가집니다. '뉴런->신경망-> 지능'이라는 도식이 '퍼셉트론->인공 신경망->인공지능'이 가능하리라 꿈꾸었던 당시 사람들은 이것이 생각보다 쉽지 않다는 것을 깨닫게 됩니다. 아주 간단한 XOR문제조차 해결할 수 없었기 때문입니다. 하지만 이 문제는 두가지 방법이 순차적으로 개발되면서 해결됩니다. 하나는 다층 퍼셉트론(Multi-Layer Perceptron), 그리고 또 하나는 오차 역전파(back propagation) 입니다.

다층 퍼셉트론은 단층 퍼셉트론과 달리 여러 계층의 뉴런(은닉층)을 추가하여 비선형 패턴을 학습할 수 있습니다.

위의 그림은 은닉층이 XOR문제를 해결해주는 과정입니다. x1과 x2를 각각 두 연산으로 보냅니다. 첫 번재 연산은 NAND 처리를 합니다. 두 번째 연산은 OR처리를 해줍니다. 첫 번째와 두 번째 연산에서 얻은 결과값을 AND처리하면 원하는 결과값이 나옵니다.

하지만 다층 퍼셉트론에도 문제가 있습니다. 은닉층에 들어 있는 가중치를 데이터를 통해 학습하는 방법이 없었기 때문입니다. 다층 퍼셉트론의 적절한 학습 방법을 찾기까지 20여 년의 시간이 더 필요했습니다. 이 기간을 흔히 인공지능의 겨울이라고 부릅니다. 이 겨울을 지나며 데이터 과학자들은 두 부류로 나뉩니다. 하나는 최적화된 예측선을 잘 그려 주던 아달라인을 전시켜 SVM(Support Vector Machine)이나 로지스틱 회귀(Logistic Regression)모델을 만드는 그룹입니다. 또 하나의 그룹은 여러 어려움 속에서도 끝까지 다층 퍼셉트론의 학습 방법을 찾던 그룹입니다. 이 두 번째 그룹에 속해 있던 제프리 힐튼(Geoffrey Hinton) 교수가 딥러닝의 아버지로 칭송받는 사람입니다. 1986년, 데이비드 럼elhart(David Rumelhart)와 제프리 힌튼(Geoffrey Hinton), 그리고 로날드 윌리엄스(Ronald Williams)는 획기적인 알고리즘을 제안했습니다. 바로 오차역전파(Backpropagation) 알고리즘입니다. 오차 역전파는 우리가 흔히 알고 있는 딥러닝의 탄생으로 이어집니다.

오차역전파는 출력값과 실제값 사이의 오차를 계산한 뒤, 이를 네트워크의 이전 계층으로 역으로 전달하여 가중치를 조정하는 방식입니다. 이 과정을 반복하면 은닉층의 가중치도 효과적으로 학습할 수 있게 됩니다.

하지만 신경망이 깊어질수록 새로운 문제가 나타났습니다. 바로 기울기 소실 문제(Vanishing Gradient Problem)입니다. 오차역전파 과정에서 출력층에서부터 전달되는 기울기가 계속해서 줄어들어, 초반부분(입력층에 가까운 층)의 가중치가 거의 학습되지 않는 현상이 발생했습니다. 특히, 시그모이드(sigmoid)와 같은 활성화 함수를 사용할 때 이 문제가 두드러졌습니다.

D깊은 층을 만들다 보면 출력층에서 시작된 가중치 업데이트가 처음 층까지 전달되지 않는 현상이 생깁니다. 만약 활성화 함수를 시그모이드로 선택했다면 시그모이드 함수를 미분하면 최대값이 0.25, 즉 1보다 작기 때문에 계속 곱하다 보면 0에 가까워 지게 됩니다. 그래서 기울기가 소실되는 문제가 생깁니다. 기울기 소실 문제로 인해 신경망의 성능은 제한을 받았고, 깊은 네트워크는 학습하기 어려웠습니다.

기울기 소실 문제를 해결하기 위해 다양한 기술이 제안되었습니다. 그 중 가장 큰 혁신은 ReLU(Rectified Linear Unit) 함수의 등장입니다.

ReLU는 간단한 식으로 정의되며, 기울기 소실 문제를 크게 완화시켰습니다. 이 외에도 배치 정규화(Batch Normalization)와 잔차 연결(Residual Connection), 그리고 He 초기화와 같은 기법들이 문제 해결에 기여했습니다.

XOR 문제에서 시작된 퍼셉트론의 한계는 인공지능 역사에서 중요한 교훈을 남겼습니다. 단순한 문제처럼 보였던 XOR은 단층 퍼셉트론의 구조적 약점을 드러내며, 인공지능의 겨울이라는 긴 침체기를 불러왔습니다. 하지만 다층 퍼셉트론과 오차역전파 알고리즘의 등장으로 우리는 비선형 문제를 해결할 수 있는 강력한 도구를 얻게 되었습니다. 이후 기울기 소실 문제와 같은 새로운 문제가 나타났지만, ReLU와 같은 혁신적인 기술과 연구자들의 끊임없는 노력 덕분에 딥러닝은 한계를 넘어섰습니다. 오늘날의 인공지능은 이미지, 음성, 자연어 처리 등 다양한 분야에서 인간의 삶을 크게 변화시키고 있습니다.

'GDG on Campus: SSWU 6th > Winter Blog Challenge' 카테고리의 다른 글

| [Winter Blog Challenge] 리그 오브 레전드 - 매칭 시스템과 서버 기술 (Team Member 이현진) (0) | 2025.02.24 |

|---|---|

| [Winter Blog Challenge] DevOps (Chapter Member 정주원) (0) | 2025.02.24 |

| [Winter Blog Challenge] 로그인 인증 방식 (Chapter Memer 전지연) (0) | 2025.02.24 |

| [Winter Blog Challenge] 검색 증강 생성의 이해 (Chapter Member 박미나) (0) | 2025.02.24 |

| [Winter Blog Challenge] 기본 머신러닝 용어 및 회귀 (Team Member 임다인) (0) | 2025.02.24 |